实时语音伪造实现突破 近100%成功率可完美复刻人声

赵美心

网络安全研究机构NCC Group最新报告显示,AI语音伪造技术已突破关键瓶颈,成功实现"实时"伪造。这项突破性进展使得攻击者能够在普通通话中即时模仿他人声音,实验中的诈骗成功率接近百分之百。

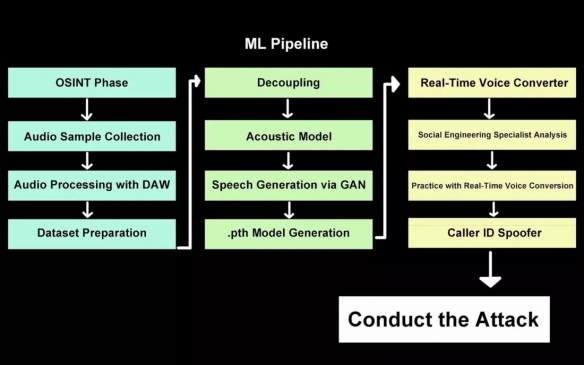

与传统变声器不同,这项被称为"深度伪造语音钓鱼"的技术基于先进的AI模型,仅需对目标声音进行短暂学习,便可在定制网页界面上实现一键启用。令人担忧的是,该技术对硬件要求并不苛刻,研究人员在一台搭载英伟达RTX A1000显卡的普通笔记本电脑上,成功实现了延迟低于0.5秒的实时语音转换,且生成效果自然流畅,几乎无法辨识真伪。

更严峻的是,该技术即使基于低质量的原始录音,仍能生成极其逼真的语音副本。相较于以往需要数分钟训练、仅能生成固定音频的旧式工具,新系统允许使用者在通话过程中根据情境实时调整语调和语速,这使得技术门槛大幅降低,普通用户借助笔记本电脑或智能手机即可实现专业级的语音伪造。

在授权进行的模拟测试中,安全顾问Pablo Alobera透露,当实时语音伪造技术与来电号码伪造结合使用时,几乎每次实验都能成功欺骗测试对象。这一结果凸显了该项技术对现有安全体系的巨大威胁。

尽管语音伪造技术突飞猛进,实时视频深度伪造仍面临技术瓶颈。专家指出,当前最先进的AI模型在实时视频生成中仍存在表情不一致、情绪不匹配及音画不同步等问题,普通观众仍能通过观察这些细节识别伪造痕迹。

随着AI伪造技术的快速普及,实际损失案例已经开始出现。有企业在招聘过程中因视频深度伪造而上当,将笔记本电脑寄往虚假地址。此类事件表明,传统的语音或视频通话已不能再作为可靠的身份验证方式。

专家强烈建议建立新型身份验证机制,提出可借鉴棒球比赛中使用的"暗号"概念,通过独特且结构化的信号或代码在远程交流中确认身份。若不及时采取应对措施,个人与机构都将面临日益复杂的AI社会工程攻击威胁,网络安全格局或将迎来重大变革。